Le giocatrici avrebbero chiesto protezione internazionale per il timore di ritorsioni.

VIRUS creati dall’Intelligenza Artificiale, adesso sono cavoli amari: possono INFETTARE gli ORGANISMI VIVENTI | Siamo alla follia

Stampa articoloL’intelligenza artificiale entra in territori mai esplorati: la scienza ora può creare virus del tutto nuovi, ma quali sono i rischi reali?

Siamo arrivati al punto in cui l’intelligenza artificiale non si limita più a scrivere testi o generare immagini. Ora crea virus. Non in senso metaforico, stiamo parlando di entità biologiche capaci di infettare e uccidere organismi viventi. Uno scenario che fino a pochi anni fa sembrava fantascienza, oggi è realtà. E il confine tra innovazione e minaccia non è mai stato così sottile.

La notizia ha fatto tremare più di un laboratorio e acceso un dibattito internazionale: se l’intelligenza artificiale può generare virus, allora può anche farlo in modo incontrollato? E se queste entità sfuggissero dai laboratori? Le preoccupazioni sono legittime, specie in un mondo che ha appena attraversato una pandemia globale. Stavolta però il pericolo non viene dalla natura, ma dalla tecnologia.

Parliamo di virus mai esistiti prima, generati completamente da un’intelligenza artificiale addestrata su milioni di sequenze genomiche. In altri termini, una macchina ha ideato da zero agenti biologici in grado di infettare esseri viventi. Sembra l’inizio di un film distopico, ma è il risultato di una ricerca concreta e documentata.

Il punto non è solo etico o filosofico. È pratico, concreto, urgente: possiamo davvero controllare le creature sintetiche che stiamo creando? Se un software è in grado di progettare un virus letale, cosa succede se lo stesso software finisce in mani sbagliate, o se qualcosa va storto nel processo? L’inquietudine cresce, così come le domande.

Virus progettati da un’IA: uno scenario mai visto prima

Dietro questa scoperta c’è un team di ricercatori statunitensi dell’Università di Stanford, in collaborazione con centri di ricerca di alto profilo come il Memorial Sloan Kettering Cancer Center. L’obiettivo era ambizioso: usare modelli linguistici simili a quelli che alimentano ChatGPT per progettare sequenze di DNA funzionali. Non solo teoria, ma biologia molecolare applicata.

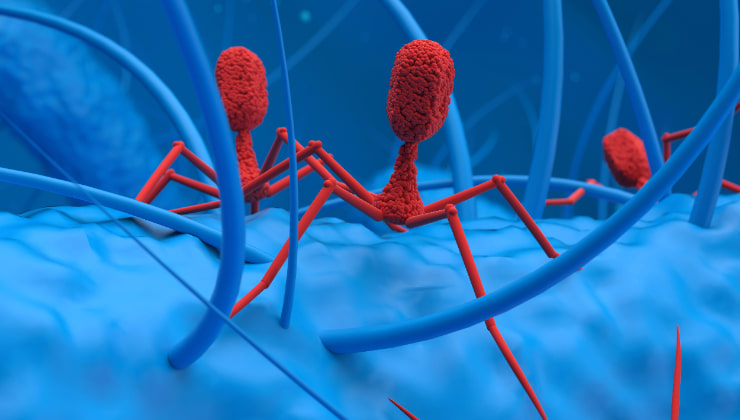

I modelli Evo 1 ed Evo 2 sono stati “nutriti” con dati genetici di oltre due milioni di virus, prendendo come riferimento il genoma di un batteriofago chiamato ΦX174. Il risultato? Circa 300 nuovi virus sintetici, sedici dei quali si sono dimostrati vitali, capaci di infettare e uccidere batteri reali. Alcuni erano completamente diversi da qualsiasi virus conosciuto.

Virus batteriofagi attaccano batteri_Donnaclick

Un’arma contro l’antibioticoresistenza, ma a quale prezzo?

L’IA ha creato virus artificiali in grado di uccidere batteri resistenti agli antibiotici. I ricercatori li hanno testati su tre ceppi di Escherichia coli, che nessun farmaco riusciva più a eliminare. Risultato: i fagi sintetici li hanno distrutti. Una scoperta potenzialmente rivoluzionaria nella lotta all’antibioticoresistenza, che potrebbe salvare milioni di vite nei prossimi decenni.

Ma attenzione: questi virus non sono “vivi” nel senso tradizionale. Non hanno metabolismo, non si riproducono da soli, non evolvono come gli organismi. Tuttavia, sono entità biologiche capaci di infettare. E soprattutto, sono state create da un’intelligenza artificiale. Il passo verso la creazione di forme di vita sintetica è breve. E se da un lato promette cure mai viste, dall’altro impone una riflessione etica e un controllo rigoroso, perché il rischio che qualcosa sfugga di mano non è più solo teoria.